La carrera por dominar la inteligencia artificial ya no se centra solo en los modelos. Cada vez más empresas compiten por controlar la infraestructura completa que permite crear, entrenar y desplegar IA. En ese contexto, NVIDIA NeMo Cloud se ha convertido en una pieza clave de la estrategia de NVIDIA para posicionarse como el proveedor principal de plataformas de inteligencia artificial para empresas.

Con el auge de los modelos generativos, muchas compañías han descubierto que depender únicamente de APIs públicas no siempre es suficiente. Las organizaciones quieren modelos personalizados, entrenados con sus propios datos y desplegados en entornos seguros. Ahí es donde entra en juego el ecosistema de NVIDIA.

La gran pregunta es: ¿está NVIDIA intentando convertirse en el AWS de los modelos de IA?

¿Qué es NVIDIA NeMo Cloud?

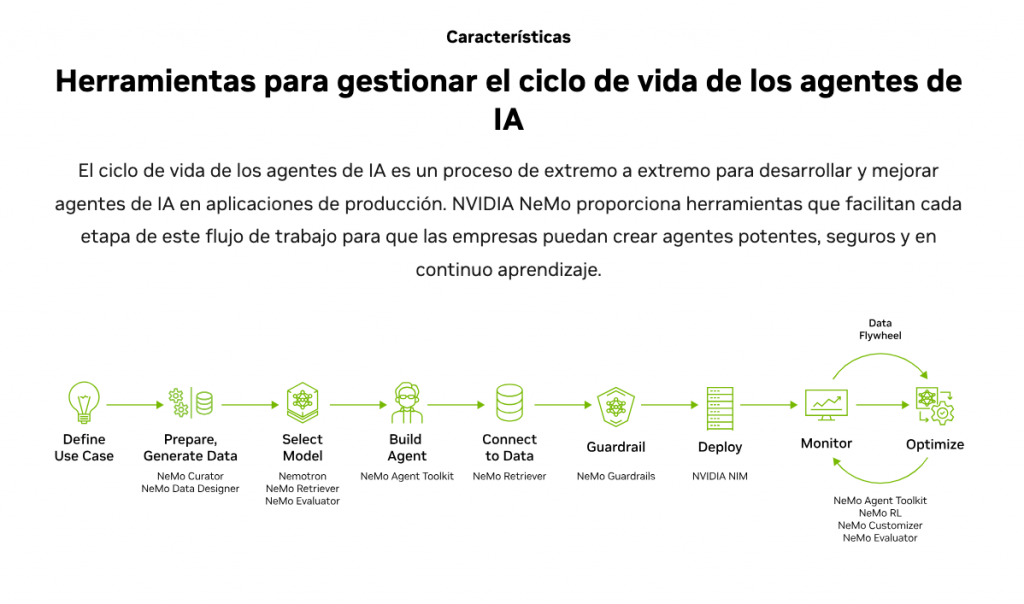

NVIDIA NeMo es un framework diseñado para crear, entrenar y desplegar modelos de inteligencia artificial generativa a gran escala. En su versión cloud, permite que empresas y desarrolladores construyan sus propios modelos de lenguaje y copilotos empresariales utilizando la infraestructura de NVIDIA.

En lugar de limitarse a ofrecer hardware, **NVIDIA está construyendo una plataforma completa para el desarrollo de IA. Esto incluye herramientas para entrenar modelos, optimizar su rendimiento y desplegarlos en producción.

Entre las capacidades más importantes de NeMo destacan:

• Entrenamiento y ajuste fino de modelos de lenguaje

• Creación de copilotos empresariales

• Integración con datos privados de la empresa

• Despliegue de modelos en entornos corporativos

• Escalabilidad sobre infraestructura GPU

En otras palabras, NeMo permite que las empresas desarrollen su propia IA en lugar de depender de modelos externos.

¿Por qué las empresas quieren sus propios modelos de IA?

El crecimiento de la IA generativa ha demostrado el enorme potencial de herramientas basadas en modelos de lenguaje. Sin embargo, para muchas empresas existen varios problemas al depender únicamente de servicios públicos.

El primero es la privacidad de los datos. Muchas organizaciones no pueden enviar información sensible a servicios externos sin comprometer la seguridad o el cumplimiento normativo.

El segundo problema es la personalización. Los modelos generalistas funcionan bien para tareas amplias, pero muchas empresas necesitan sistemas especializados entrenados con datos propios.

El tercero es el control de la infraestructura. Al construir sus propios modelos, las compañías pueden optimizar costes, rendimiento y gobernanza de la IA.

Por estas razones, cada vez más empresas buscan soluciones que les permitan crear y gestionar modelos de inteligencia artificial internamente.

¿Cómo funciona el ecosistema de IA de NVIDIA?

Lo interesante de la estrategia de NVIDIA es que no se limita a vender GPUs. La compañía está desarrollando un ecosistema completo que cubre todas las capas necesarias para construir aplicaciones de inteligencia artificial.

Este stack incluye:

Hardware

Las GPUs de NVIDIA se han convertido en el estándar de facto para entrenar modelos de inteligencia artificial a gran escala.

Software

Frameworks como NeMo permiten desarrollar y entrenar modelos generativos optimizados para GPUs NVIDIA.

Infraestructura cloud

Servicios como DGX Cloud proporcionan la capacidad de computación necesaria para entrenar y ejecutar modelos complejos.

Servicios de inferencia

Las herramientas de despliegue permiten ejecutar modelos en producción con alta eficiencia.

Al controlar todas estas capas, NVIDIA puede ofrecer a las empresas una plataforma completa para construir aplicaciones de inteligencia artificial.

¿Por qué NVIDIA quiere convertirse en el AWS de la IA?

Durante la revolución del cloud computing, empresas como Amazon se convirtieron en actores dominantes porque ofrecieron infraestructura digital bajo demanda. En lugar de comprar servidores, las empresas podían simplemente alquilar capacidad en la nube.

Algo muy similar está ocurriendo ahora con la inteligencia artificial.

En lugar de desarrollar toda la infraestructura desde cero, muchas empresas preferirán utilizar plataformas que ya integren hardware, herramientas de desarrollo y servicios de despliegue.

Aquí es donde NVIDIA ve una enorme oportunidad.

Si las compañías construyen sus modelos utilizando el stack de NVIDIA, dependerán de su ecosistema para entrenar, ejecutar y escalar sus sistemas de IA.

Esto convierte a NVIDIA en algo más que un fabricante de chips. La empresa está evolucionando hacia un proveedor de infraestructura para la economía de la inteligencia artificial.

¿Qué significa esto para el futuro de la IA?

Si esta estrategia tiene éxito, el mercado de la inteligencia artificial podría evolucionar hacia un modelo similar al del cloud computing.

Las empresas no solo competirán en modelos, sino también en plataformas completas para crear y desplegar inteligencia artificial.

En ese escenario, NVIDIA podría ocupar una posición central al proporcionar la infraestructura sobre la que se ejecuten miles de aplicaciones de IA.

La combinación de hardware especializado, software optimizado y plataformas cloud podría convertir a NVIDIA en uno de los actores más influyentes de la próxima década tecnológica.

Conclusión

El lanzamiento y expansión de NVIDIA NeMo Cloud muestra que la competencia en inteligencia artificial ya no se limita a los modelos. La verdadera batalla se está librando en la infraestructura que permite construirlos y operarlos a gran escala.

Al ofrecer herramientas para entrenar, personalizar y desplegar modelos empresariales, NVIDIA está posicionándose como un proveedor clave para las compañías que quieren desarrollar su propia IA.

Si esta estrategia continúa creciendo, es posible que dentro de unos años muchas empresas construyan sus sistemas de inteligencia artificial sobre la misma plataforma.

En ese caso, NVIDIA no solo dominaría el hardware de la IA. También podría convertirse en el AWS de los modelos de inteligencia artificial.

¿Qué opinas? ¿Crees que NVIDIA dominará también la infraestructura de IA o veremos nuevas plataformas competir por ese espacio?