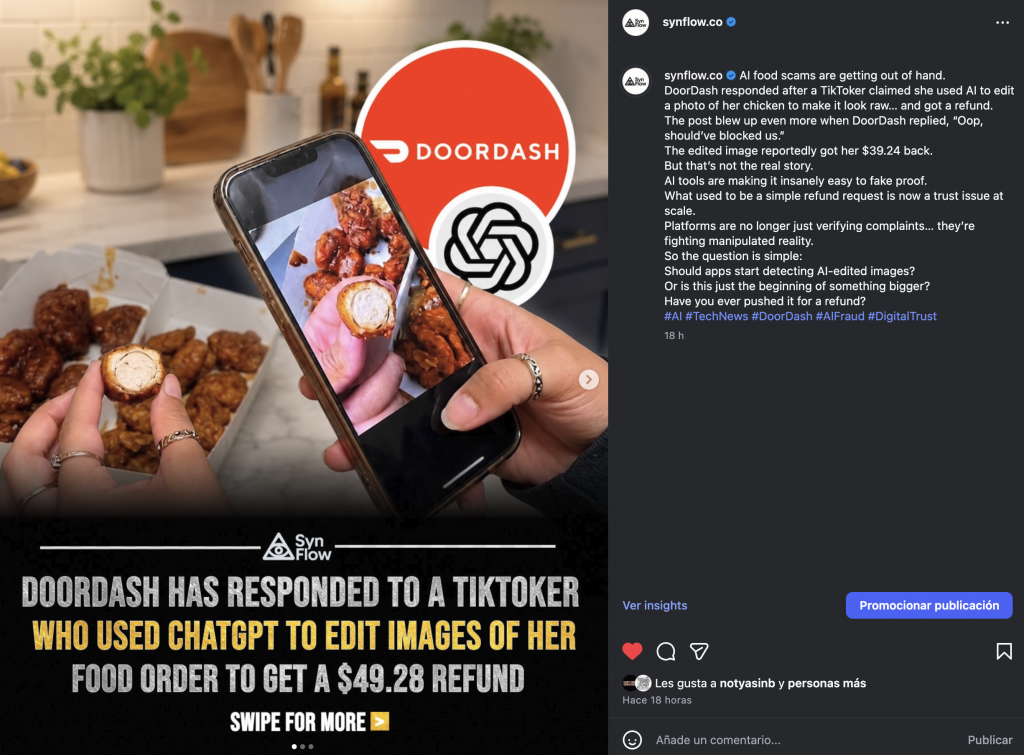

La inteligencia artificial está abriendo nuevas oportunidades… pero también nuevos problemas. Un caso reciente lo demuestra: una usuaria logró obtener un reembolso de DoorDash tras editar con IA una imagen de su pedido de comida para hacerlo parecer defectuoso.

Lo que comenzó como un caso viral en TikTok ha encendido un debate más amplio: ¿cómo pueden las plataformas confiar en la evidencia visual en la era de la IA?

¿Qué ocurrió exactamente?

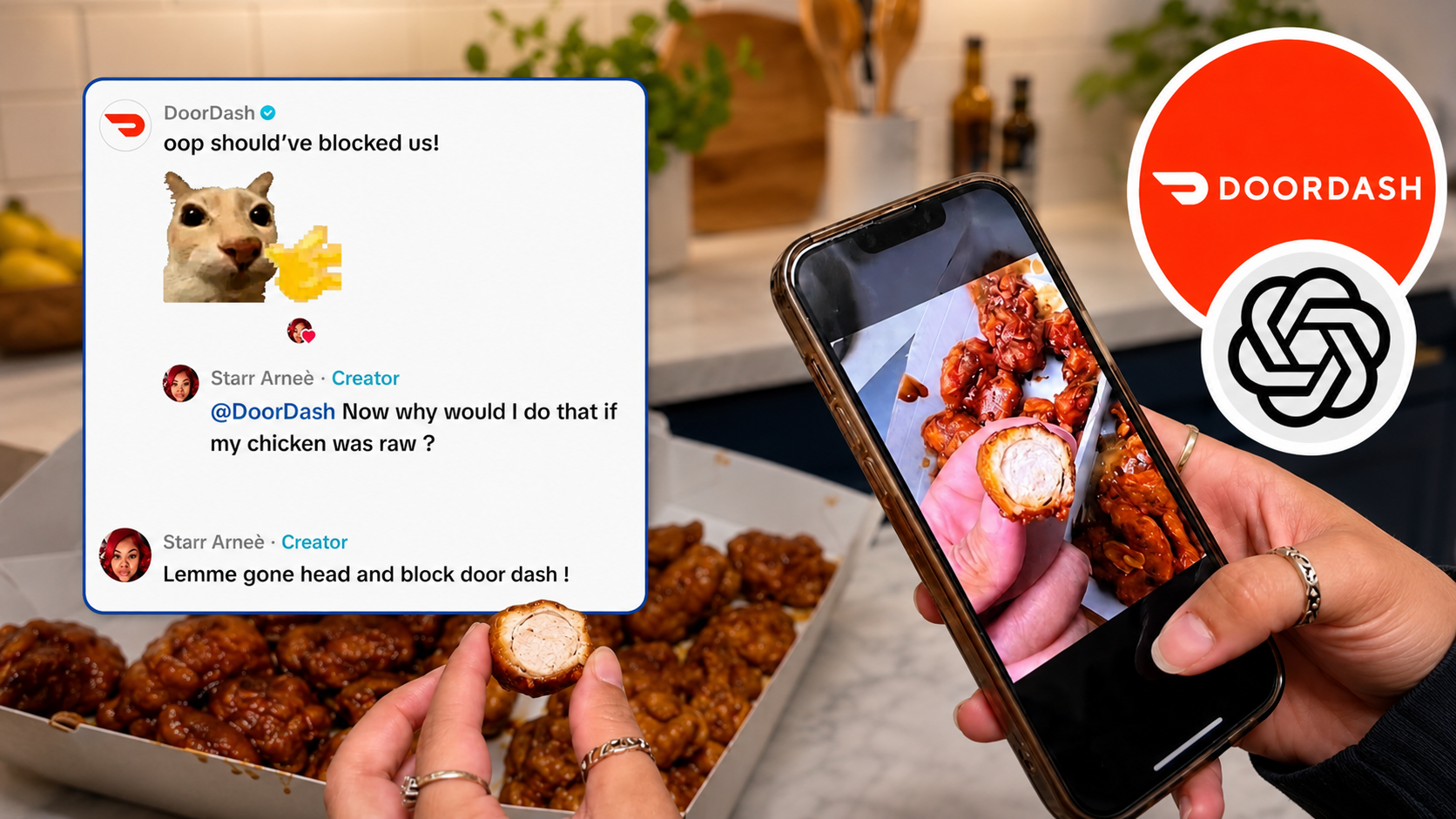

Una creadora de contenido afirmó haber utilizado herramientas de inteligencia artificial para modificar una foto de su comida —en este caso, pollo— haciéndolo parecer crudo o en mal estado.

Con esa imagen manipulada, solicitó un reembolso a DoorDash… y lo consiguió.

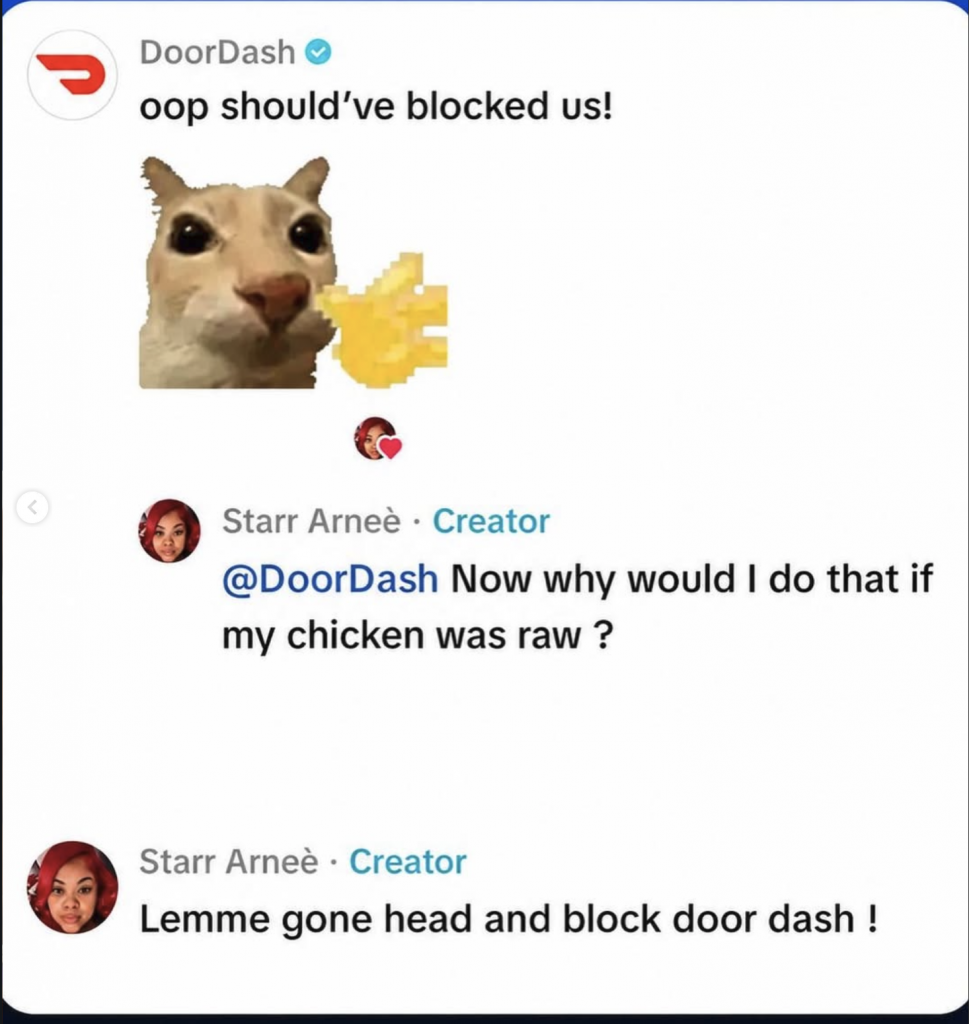

El caso se volvió viral cuando la propia plataforma respondió con humor:

“Deberíamos haberte bloqueado”, aumentando aún más la visibilidad del problema.

El verdadero problema: la prueba ya no es fiable

Durante años, las plataformas han confiado en fotos como prueba en procesos de reclamación. Sin embargo, la IA está cambiando completamente las reglas del juego.

Hoy en día, cualquier usuario puede:

- Alterar imágenes con facilidad

- Generar contenido falso realista

- Simular problemas inexistentes

Esto convierte algo tan simple como una foto en una prueba potencialmente manipulada.

De reclamaciones simples a crisis de confianza

Lo que antes era un proceso sencillo —enviar una foto para justificar un reembolso— ahora se convierte en un desafío complejo.

Las plataformas enfrentan un nuevo tipo de fraude:

- Difícil de detectar

- Escalable

- Accesible para cualquier usuario

Esto no solo afecta a empresas como DoorDash, sino a todo el ecosistema digital donde se utilizan pruebas visuales.

¿Cómo pueden responder las plataformas?

Ante este nuevo escenario, las empresas tendrán que evolucionar sus sistemas de verificación. Algunas posibles soluciones incluyen:

- Detección de imágenes generadas o editadas con IA

- Verificación multifactor (no depender solo de fotos)

- Análisis de comportamiento del usuario

- Uso de metadatos y señales técnicas

El objetivo será pasar de confiar en una sola prueba a evaluar múltiples señales de autenticidad.

El inicio de una nueva era: fraude impulsado por IA

Este caso no es aislado, sino una señal de algo mayor. La inteligencia artificial está democratizando herramientas que antes solo estaban al alcance de expertos.

Esto implica que el fraude digital podría:

- Aumentar en volumen

- Volverse más sofisticado

- Ser más difícil de rastrear

Estamos entrando en una etapa donde la línea entre lo real y lo manipulado es cada vez más difusa.

Conclusión: la IA está redefiniendo la confianza digital

El caso de DoorDash revela una verdad incómoda: los sistemas actuales no están preparados para un mundo donde la evidencia puede ser fácilmente alterada.

La inteligencia artificial no solo está transformando la productividad, sino también los riesgos.

La gran pregunta ahora es:

¿cómo se reconstruye la confianza en internet cuando cualquier prueba puede ser falsa?